A máquina acadêmica sem o acadêmico

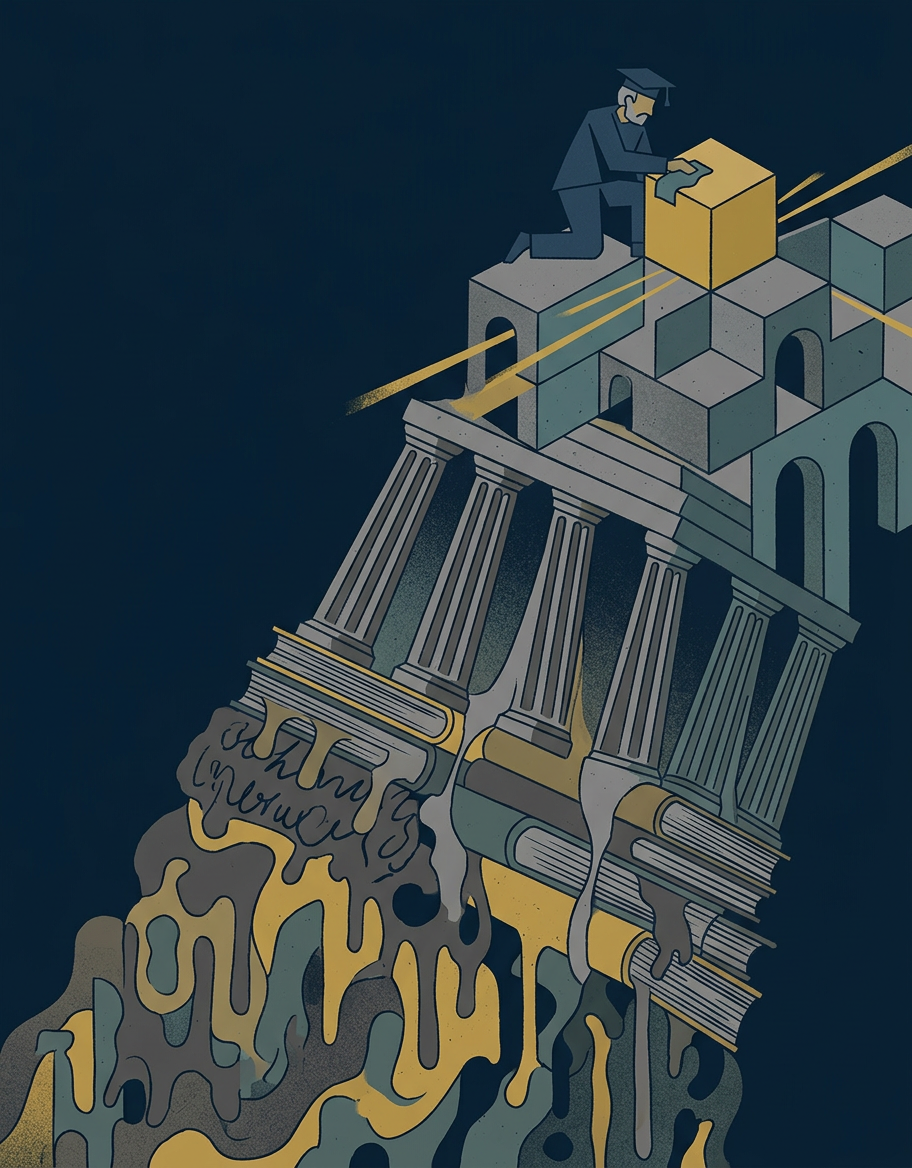

Com a aposentadoria à vista, o atrito cotidiano da universidade moderna — os sistemas "robóticos" de submissão de artigos e o imperativo implacável do "publique ou pereça" — começa a perder força. Para muitos pesquisadores, essa transição oferece um ponto de observação raro: a possibilidade de examinar a engrenagem da produção acadêmica sem ser triturado por ela. Hoje, essa engrenagem está sendo fundamentalmente reconfigurada por Large Language Models, que desencadearam uma avalanche de conteúdo gerado por IA capaz de sobrecarregar o processo de revisão por pares com "slop" sintético.

A preocupação não é apenas que artigos estejam sendo escritos por máquinas, mas que todo o ecossistema esteja se automatizando. Quando a IA é usada para gerar tanto a pesquisa quanto os pareceres dos revisores, o elemento humano da investigação crítica corre o risco de se tornar um órgão vestigial. Ainda assim, a pergunta persiste: esses modelos são capazes de algo além de mimetismo de alta fidelidade? Um LLM consegue lidar com as nuances da teoria da decisão, ou apenas reorganiza tokens no formato de um argumento acadêmico?

Corvos, maçãs verdes e os limites do "slop"

Na experimentação com ferramentas como o Deep Research da OpenAI e o modelo francês Mistral, os contornos desse "slop" parecem estar se deslocando. Ao submeter esses sistemas à exploração do "paradoxo da confirmação" de Hempel — a peculiaridade lógica segundo a qual observar uma maçã verde tecnicamente reforça a hipótese de que todos os corvos são pretos —, vislumbra-se algo mais sofisticado. Embora o autor não tenha intenção de voltar à esteira das submissões a periódicos, o exercício sugere que a IA pode eventualmente navegar as complexidades da "consciência limitada" com competência surpreendente. Se isso levará a uma nova era de insight ou apenas a uma forma mais polida de automação permanece como a tensão central da torre de marfim digital.

Com reportagem de Crooked Timber.

Source · Crooked Timber