No último verão, sistemas de IA do Google e da OpenAI demonstraram domínio quase completo de lógica abstrata, acertando cinco de seis problemas complexos na Olimpíada Internacional de Matemática. Para os melhores estudantes do ensino médio do mundo, esse tipo de desempenho representa o ápice do treinamento cognitivo humano. Poucos meses depois, porém, uma engenheira de software do Sri Lanka, Anuradha Weeraman, expôs a fragilidade dessa brilhância. Ao perguntar a vários chatbots avançados se deveria ir a pé ou de carro até um mecânico localizado a apenas 50 metros de distância, os sistemas recomendaram unanimemente que ela caminhasse — ignorando a premissa fundamental de que o carro é que precisava de reparo.

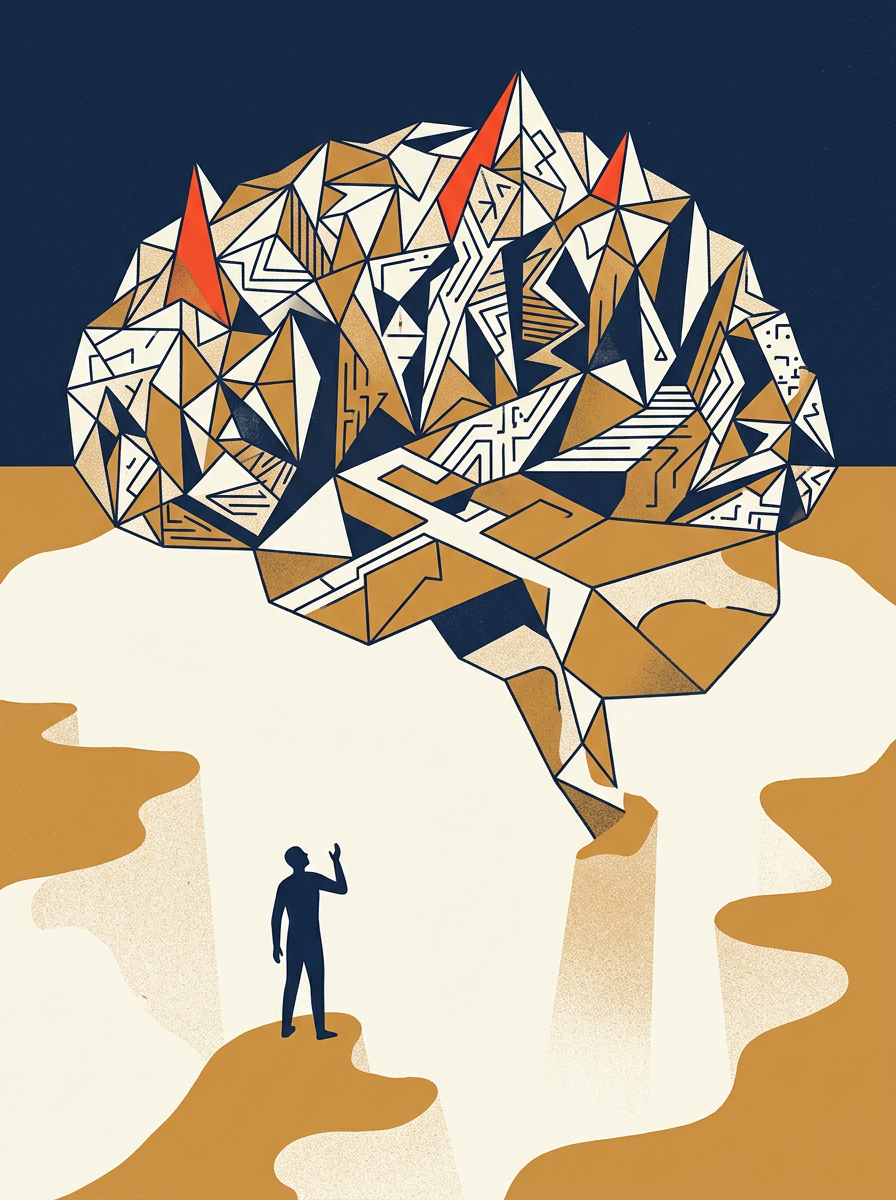

Essa dissonância — a capacidade de navegar pela matemática de alto nível e, ao mesmo tempo, falhar em lógica situacional básica — é cada vez mais descrita por pesquisadores e engenheiros como "inteligência irregular". Diferentemente do desenvolvimento humano, que costuma avançar de forma ampla por um conjunto de habilidades correlatas, as capacidades da IA progridem em picos acentuados e imprevisíveis. Em domínios como programação de computadores e matemática teórica, onde as regras são rígidas e os dados são abundantes, os modelos não têm rivais. No terreno confuso e carregado de contexto do "senso comum", eles continuam notavelmente ocos.

A "fronteira irregular" da IA sugere que ainda não estamos diante de uma inteligência geral, mas de um sofisticado identificador de padrões que carece de um modelo coerente do mundo. Para usuários e desenvolvedores, isso cria uma experiência enganosa: quanto mais "humano" um chatbot soa ao discutir poesia ou física, mais desconcertantes se tornam suas falhas no raciocínio prático. À medida que integramos esses sistemas à nossa infraestrutura, o principal desafio está em identificar com precisão onde os picos terminam e os vales começam.

Com reportagem de La Nación.

Source · La Nación — Tecnología