Na sexta-feira, a empresa chinesa de IA DeepSeek divulgou uma prévia do V4, seu novo modelo principal, em duas versões — V4-Pro, voltado para programação e tarefas complexas com agentes, e V4-Flash, uma variante mais leve projetada para velocidade e eficiência de custo. Ambas as versões processam até um milhão de tokens de contexto, um salto significativo em relação à geração anterior da empresa, segundo reportagem do MIT Technology Review.

O lançamento é o mais relevante da DeepSeek desde o R1, o modelo de raciocínio que pegou a indústria global de IA de surpresa em janeiro de 2025 com seu desempenho robusto usando poder computacional limitado. Mas, se a história do R1 era sobre eficiência de treinamento, a contribuição do V4 pode ser estruturalmente mais significativa: ele introduz uma reformulação arquitetural na forma como modelos de IA lidam com textos longos, comprimindo informações mais antigas enquanto preserva detalhes próximos, e com isso reduz drasticamente o custo de inferência em contextos longos. As implicações vão muito além de um único lançamento de modelo — elas tocam a economia de construir aplicações baseadas em IA em escala.

Repensar a atenção, não apenas expandi-la

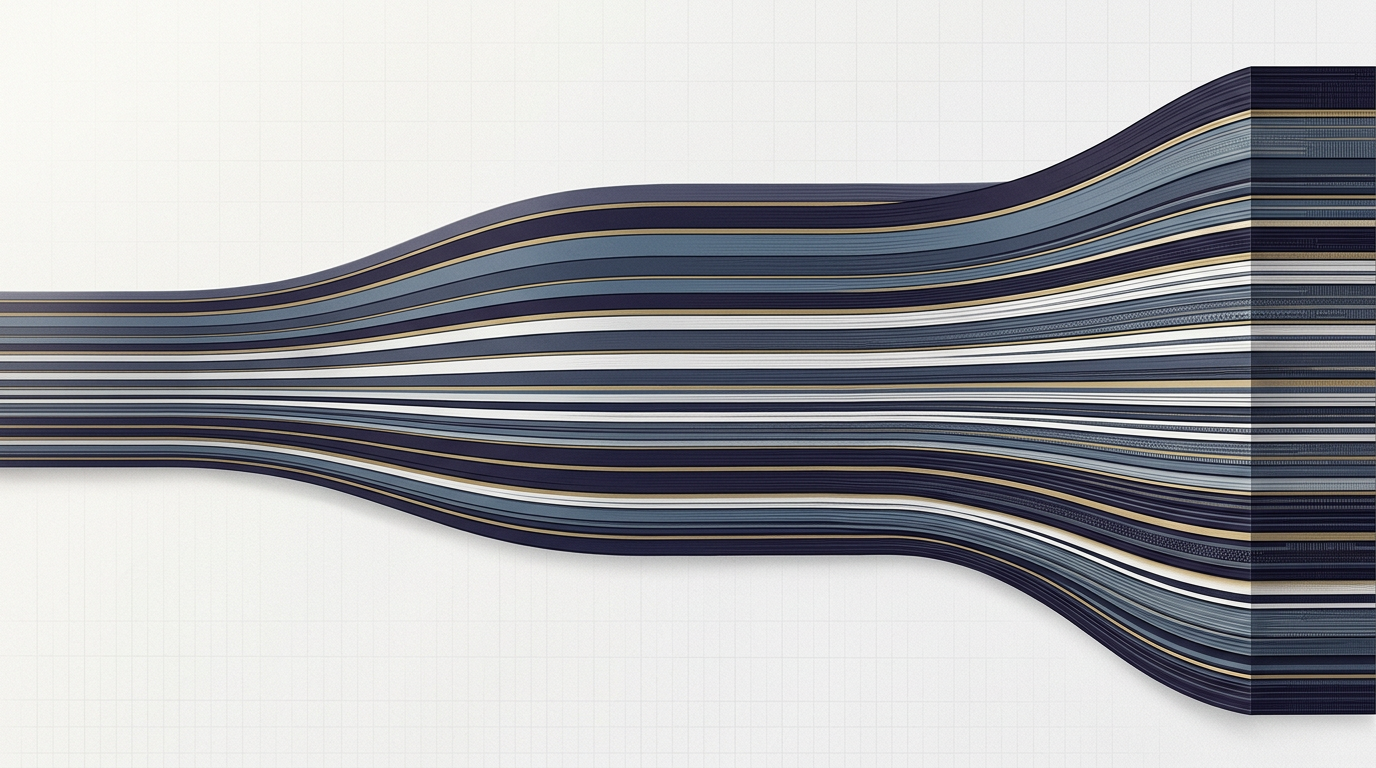

A inovação técnica central do V4 está em seu mecanismo de atenção — o componente de um modelo de linguagem responsável por entender como cada parte de um prompt se relaciona com todas as outras. À medida que o comprimento da entrada cresce, o custo computacional desse processo escala de forma agressiva, tornando janelas de contexto longo uma das funcionalidades mais caras de sustentar. A maioria dos modelos de fronteira enfrentou esse problema simplesmente jogando mais hardware na equação. A DeepSeek seguiu outro caminho.

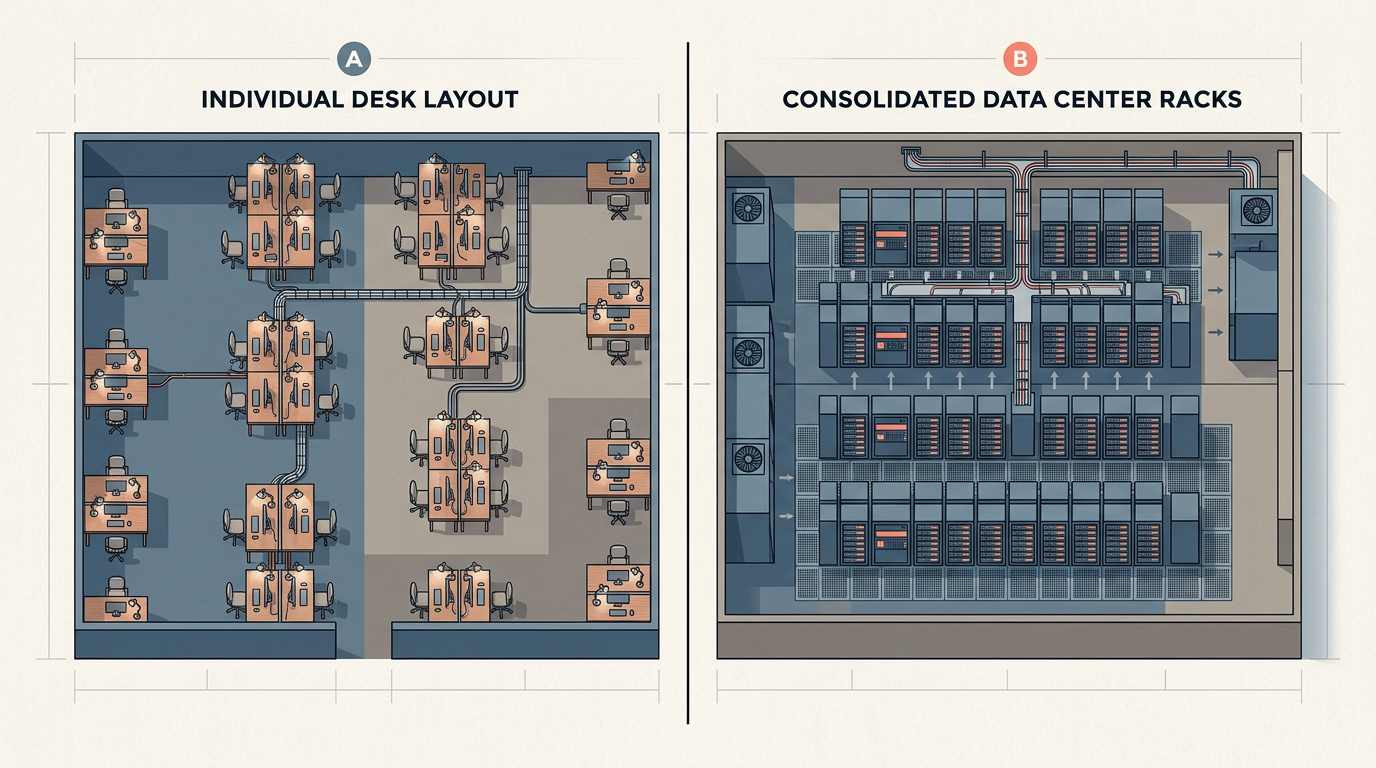

A arquitetura do V4 torna o modelo mais seletivo sobre o que ele processa. Em vez de tratar todo o texto anterior como igualmente relevante, ele comprime o contexto mais antigo e concentra poder de processamento nas porções com maior probabilidade de importar em cada etapa, mantendo o texto próximo em resolução total. De acordo com o relatório técnico da DeepSeek, isso reduz os requisitos de computação do V4-Pro em um contexto de um milhão de tokens para apenas 27% do que seu antecessor V3.2 exigia, ao mesmo tempo em que corta o uso de memória para 10%. O V4-Flash vai ainda mais longe: 10% do poder computacional, 7% da memória. Não se trata de ganhos marginais — eles representam uma curva de custo fundamentalmente diferente para inferência em contextos longos, uma que pode tornar aplicações como assistentes de IA para bases de código inteiras ou agentes de pesquisa em documentos extensos economicamente viáveis de maneiras que antes não eram.

Open source, distância fechada

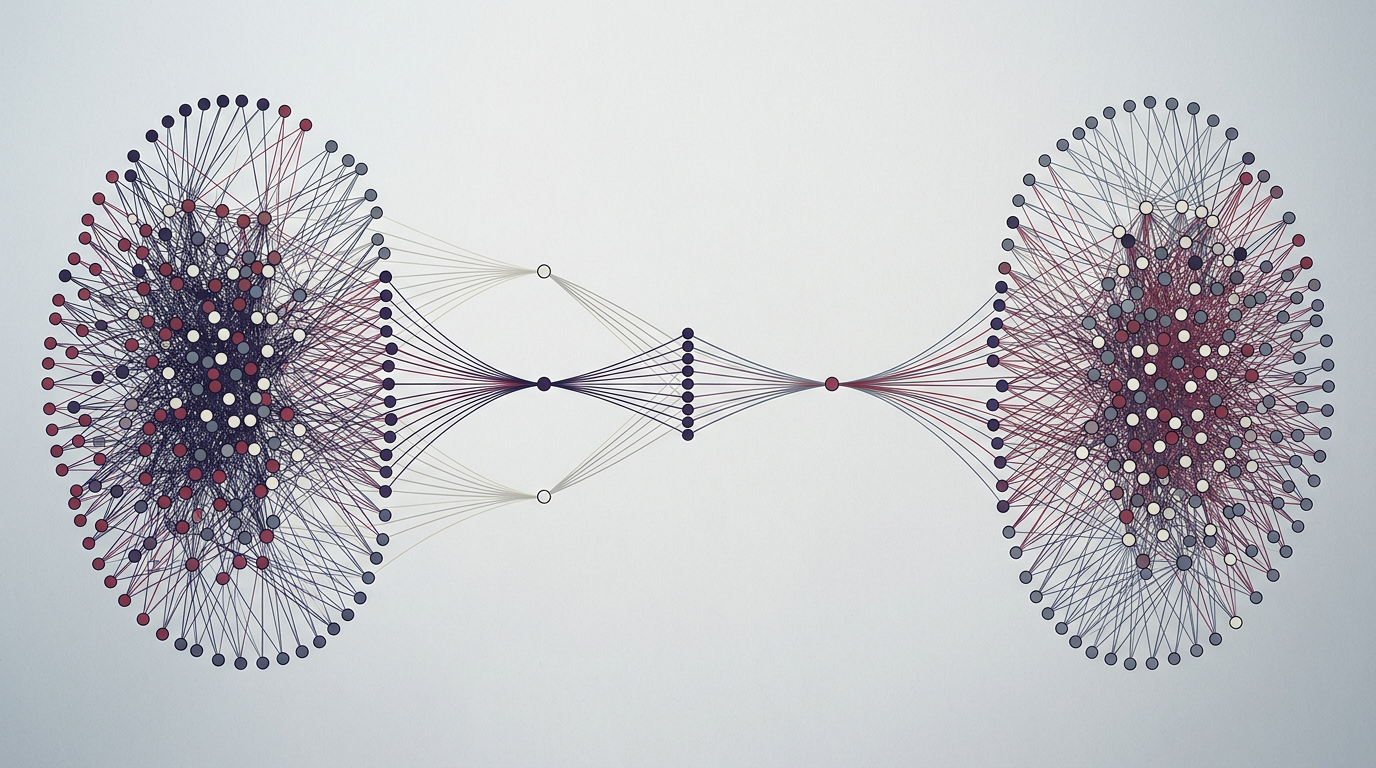

A decisão da DeepSeek de lançar o V4 como open source amplifica o avanço arquitetural. Segundo resultados de benchmarks divulgados pela empresa, o V4-Pro iguala o desempenho dos principais modelos de código fechado da Anthropic, OpenAI e Google, ao mesmo tempo em que supera outras alternativas open source da Alibaba e Z.ai em tarefas de programação, matemática e STEM. A US$ 1,74 por milhão de tokens de entrada para o V4-Pro e cerca de US$ 0,14 para o V4-Flash, os preços ficam muito abaixo dos principais concorrentes.

Para o ecossistema mais amplo de IA, isso cria uma tensão relevante. Se um modelo open source consegue entregar desempenho de fronteira a uma fração do custo — e fazê-lo com requisitos de memória drasticamente menores —, a proposta de valor do acesso a APIs de código fechado se torna mais difícil de justificar para muitos casos de uso. Desenvolvedores que constroem sobre o V4 ganham não apenas vantagens de preço, mas flexibilidade arquitetural: a capacidade de rodar e modificar modelos em sua própria infraestrutura, ajustados às suas próprias necessidades. O relatório da DeepSeek apontou que, em uma pesquisa interna com 85 desenvolvedores experientes, mais de 90% classificaram o V4-Pro entre suas principais escolhas para tarefas de programação. Se essa preferência se sustenta em escala ainda está por se ver, mas o sinal é claro.

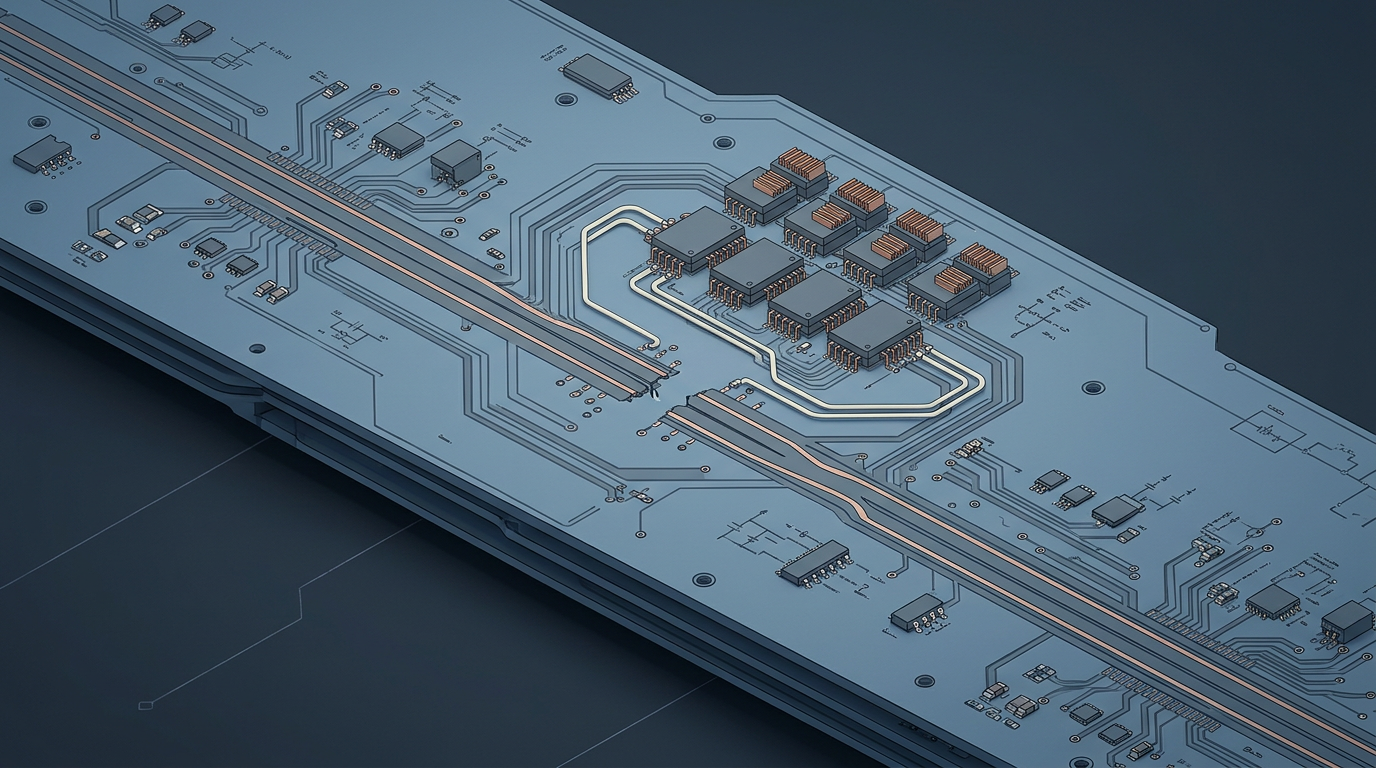

O lançamento também carrega peso geopolítico. O V4 é o primeiro modelo da DeepSeek otimizado para chips chineses domésticos, incluindo a série Ascend da Huawei — um desenvolvimento que testa se a busca da China por autossuficiência em semicondutores pode se estender à IA de fronteira. A DeepSeek aparentemente não abandonou a Nvidia por completo; seu relatório técnico indica que os chips chineses estão sendo usados principalmente para inferência, não necessariamente para o pipeline completo de treinamento. Mas a direção é inequívoca, e a arquitetura eficiente em memória do V4 pode se mostrar particularmente adequada a hardware que não tem a potência bruta da Nvidia, mas consegue lidar com cargas de inferência mais leves.

À medida que a economia da IA de contexto longo se transforma e a fronteira open source continua a estreitar a distância em relação aos modelos proprietários, a pergunta já não é se arquiteturas eficientes conseguem competir — mas com que velocidade o restante da indústria se adapta a um mundo em que elas competem.

Com reportagem de MIT Technology Review

Source · MIT Technology Review