Em fevereiro de 2025, Andrej Karpathy, cofundador da OpenAI, sintetizou uma mudança na natureza do trabalho técnico com um único termo: "vibe coding". A premissa é enganosamente simples: em vez de lidar com sintaxe e lógica, o usuário descreve o resultado desejado a um modelo de IA — um site, uma ferramenta, um jogo — e a máquina traduz essa "vibe" em código funcional. É a democratização definitiva do desenvolvimento de software, em que a imaginação se torna a principal barreira de entrada.

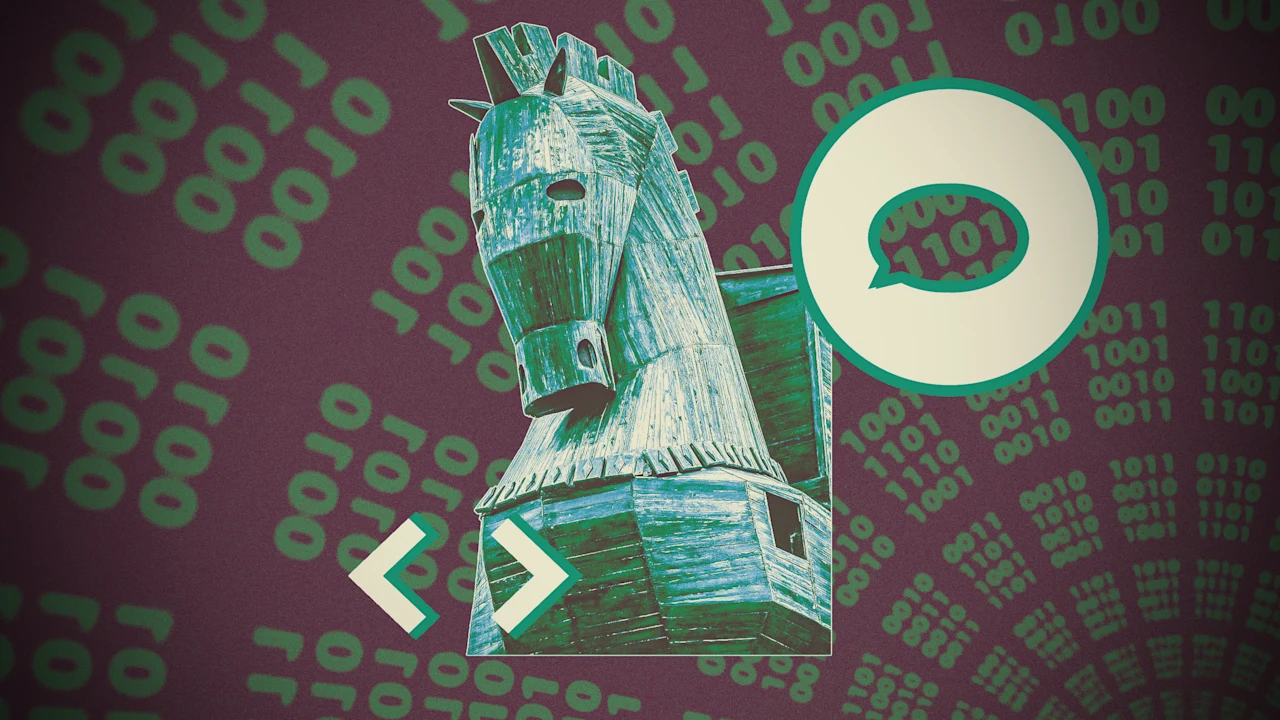

Se por um lado isso representa um salto de produtividade, por outro introduz uma opacidade arquitetural profunda. Quando o código é gerado "no vibe", o usuário frequentemente não tem a competência técnica para auditar o que a IA de fato produziu. O software parece funcionar na superfície, mas sua lógica interna permanece uma caixa-preta. Isso abre caminho para que scripts não verificados atravessem diretamente o perímetro de cibersegurança de uma empresa, muitas vezes sem passar pelo crivo tradicional das equipes de TI.

O risco fundamental está na questão da procedência. Modelos de IA são motores de reconhecimento de padrões: sintetizam código a partir de vastos conjuntos de dados sem considerar a intenção ou a postura de segurança da fonte original. O prompt engenhoso de um funcionário pode gerar uma solução derivada de um projeto acadêmico de alto nível — ou pode, inadvertidamente, replicar um padrão criado por um agente malicioso. Como a IA é "cegamente alheia" à origem de seus resultados, a responsabilidade pela segurança recai inteiramente sobre um usuário que talvez não saiba identificar uma vulnerabilidade.

Com reportagem de Fast Company.

Source · Fast Company