O Google DeepMind publicou detalhes sobre o Decoupled DiLoCo, um método de treinamento distribuído projetado para tornar o treinamento de grandes modelos de IA mais resiliente e eficiente em hardware geograficamente disperso e conectado de forma precária. Segundo o blog do DeepMind, a abordagem se baseia no framework anterior DiLoCo (Distributed Low-Communication), estendendo-o com um mecanismo de sincronização desacoplada que tolera falhas e instabilidade de rede durante as rodadas de treinamento.

O anúncio chega num momento em que a indústria de IA enfrenta os limites práticos de escalar o treinamento de modelos. À medida que os modelos de fronteira crescem, a infraestrutura necessária para treiná-los — milhares de aceleradores rigidamente sincronizados por interconexões de alta largura de banda — se torna ao mesmo tempo um gargalo e um ponto único de falha. O Decoupled DiLoCo representa a tentativa do DeepMind de afrouxar essas restrições, e suas implicações vão muito além dos data centers do próprio Google.

Repensar a sincronização no treinamento distribuído

O treinamento distribuído convencional depende de sincronização frequente e rigidamente coordenada de gradientes entre todos os dispositivos participantes. Essa abordagem funciona bem dentro de um único data center equipado com interconexões rápidas, mas escala mal entre múltiplos sites ou hardware heterogêneo. Uma única falha de nó ou oscilação de rede pode travar ou corromper uma rodada inteira de treinamento, desperdiçando tempo de computação que, na escala de fronteira, se traduz em custos significativos.

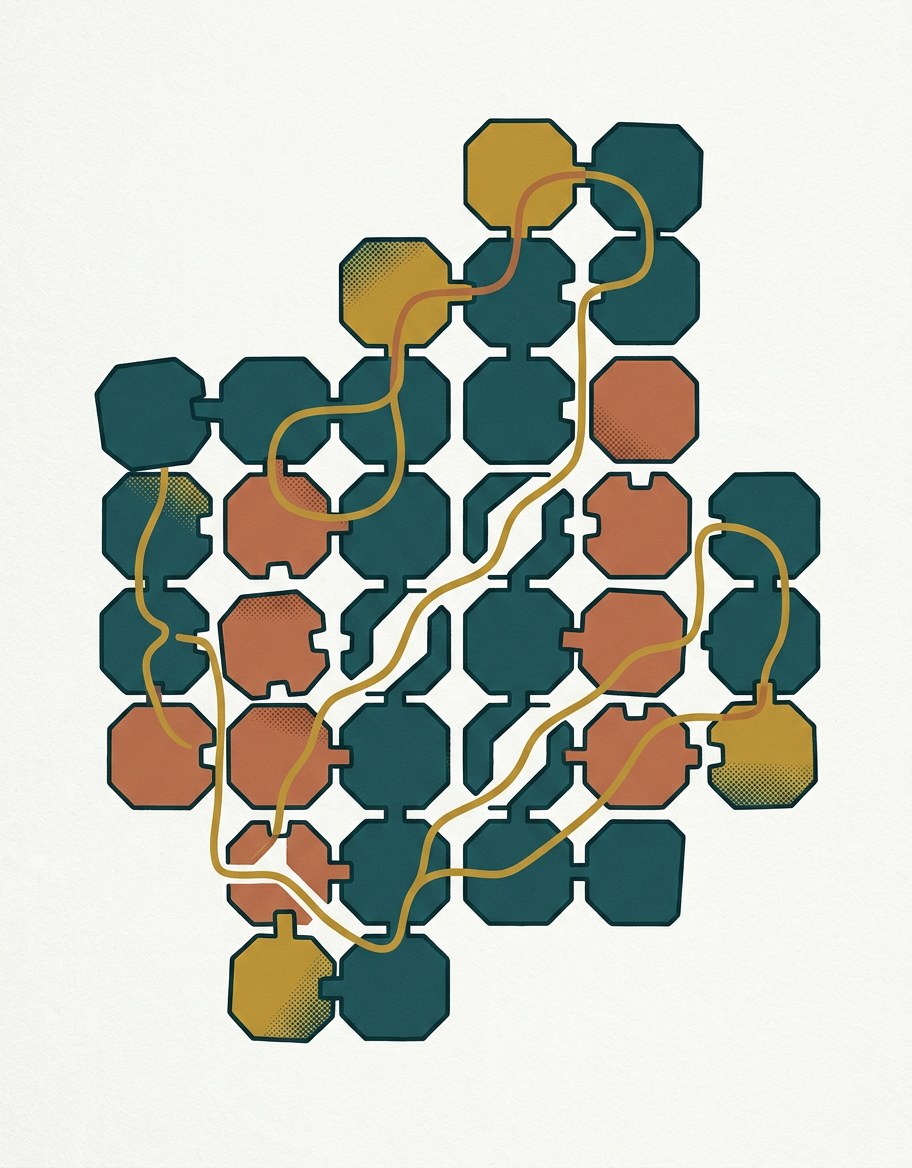

O DiLoCo, o framework predecessor, resolveu parte desse problema ao reduzir a frequência de sincronização — permitindo que grupos de workers treinassem de forma semi-independente por intervalos mais longos antes de consolidar seus avanços. O Decoupled DiLoCo vai além, eliminando a exigência de que todos os grupos de workers se sincronizem ao mesmo tempo. Segundo o blog do DeepMind, esse desacoplamento significa que grupos individuais de workers podem avançar no próprio ritmo, e o sistema consegue lidar de forma elegante com retardatários, falhas parciais ou condições de rede desiguais sem interromper todo o processo de treinamento. O resultado é um paradigma de treinamento fundamentalmente mais tolerante às realidades caóticas da computação distribuída em larga escala.

Implicações para a corrida da infraestrutura de treinamento

A relevância do Decoupled DiLoCo vai além da elegância de engenharia. Hoje, apenas um punhado de organizações possui a infraestrutura de computação concentrada necessária para treinar modelos de fronteira — clusters massivos de dezenas de milhares de GPUs ou TPUs conectados por redes customizadas de alta largura de banda. Essa concentração cria gargalos tanto econômicos quanto geopolíticos. Um método que viabilize treinamento eficaz em hardware fracamente acoplado e geograficamente distribuído poderia, em princípio, democratizar o acesso ao desenvolvimento de modelos em larga escala.

Dito isso, a distância entre um resultado de pesquisa promissor e uma infraestrutura pronta para produção é considerável. A publicação do DeepMind demonstra a viabilidade da abordagem, mas restam perguntas sobre como o Decoupled DiLoCo se comporta nas escalas de modelo realmente grandes, como interage com diferentes configurações de hardware e se as propriedades de convergência se mantêm em regimes de treinamento diversos. Há também a questão de se concorrentes — e a comunidade open-source mais ampla — vão adotar ou adaptar técnicas semelhantes. A própria pesquisa da Meta em treinamento distribuído, assim como os esforços de startups focadas em computação descentralizada, sugerem que o apetite por métodos de treinamento tolerantes a falhas é generalizado. A contribuição do DeepMind pode acelerar uma mudança mais ampla na forma como a indústria pensa a relação entre topologia de hardware e algoritmos de treinamento.

À medida que as rodadas de treinamento de IA ficam mais longas, mais caras e mais dependentes de recursos globalmente distribuídos, a resiliência do próprio processo de treinamento se torna uma preocupação de primeira ordem. O Decoupled DiLoCo oferece um caminho crível, mas se ele se tornará o paradigma dominante — ou apenas mais um ingrediente num kit de ferramentas mais amplo — dependerá de quão bem sobrevive ao contato com a complexidade total das cargas de trabalho em escala de produção. Para desenvolvedores e equipes de infraestrutura que acompanham a fronteira, a mensagem é clara: a arquitetura do treinamento está se tornando tão importante quanto a arquitetura dos próprios modelos.

Com reportagem de DeepMind Blog

Source · DeepMind Blog